Dalam lanskap teknologi yang terus berkembang, Apple selalu dikenal dengan standar kualitas dan keamanan yang ketat, terutama dalam ekosistem App Store-nya. Kebijakan kurasi yang rigid ini bertujuan untuk memastikan setiap aplikasi yang tersedia memberikan pengalaman pengguna yang optimal, aman, dan konsisten. Baru-baru ini, sebuah laporan menarik menjadi sorotan publik: Apple dikabarkan mulai menolak aplikasi yang dihasilkan melalui metode “vibe coding”, sebuah pendekatan yang seringkali mengandalkan AI generatif untuk mempercepat proses pengembangan. Penolakan ini didasari kekhawatiran akan kualitas, keamanan, dan konsistensi kode yang dihasilkan secara otomatis, yang mungkin sulit diverifikasi melalui proses review tradisional. Namun, di tengah kebijakan ketat ini, muncul sebuah kontroversi yang memicu perdebatan sengit. Dugaan kuat mengemuka bahwa Apple, di balik layar, justru memanfaatkan teknologi AI serupa, khususnya model bahasa besar Claude AI, untuk kebutuhan internal mereka. Situasi ini menimbulkan pertanyaan besar mengenai standar ganda dan konsistensi kebijakan Apple, serta implikasinya terhadap masa depan inovasi AI dalam ekosistem mereka. Artikel ini akan mengupas tuntas duduk perkara di balik “Apple Blokir Aplikasi Vibe Coding” namun diduga menggunakan Claude AI secara internal, menganalisis alasan di balik kebijakan tersebut, bukti yang muncul, serta perdebatan yang menyertainya. Kami akan membahas bagaimana Apple mencoba menyeimbangkan antara menjaga integritas platform dan merangkul inovasi AI yang tak terhindarkan.

Kebijakan Ketat Apple App Store dan Penolakan “Vibe Coding”

Apple telah lama memposisikan App Store sebagai ekosistem aplikasi yang premium, aman, dan terkurasi dengan cermat. Filosofi ini tercermin dalam pedoman App Store Review yang sangat detail, mencakup aspek fungsionalitas, desain, keamanan, dan privasi. Tujuan utamanya adalah untuk melindungi pengguna dari aplikasi berkualitas rendah, berbahaya, atau yang melanggar privasi. Dalam konteks ini, munculnya “vibe coding” menjadi tantangan baru. Istilah ini merujuk pada praktik pengembangan aplikasi yang sangat mengandalkan alat generatif, seperti AI, untuk menghasilkan sebagian besar kode atau bahkan keseluruhan aplikasi dengan cepat. Meskipun menjanjikan efisiensi, Apple melihat potensi risiko dalam metode ini, termasuk kurangnya kontrol kualitas, kerentanan keamanan yang tersembunyi, dan inkonsistensi dalam pengalaman pengguna. Oleh karena itu, langkah Apple untuk menolak aplikasi hasil “vibe coding” di App Store adalah upaya untuk mempertahankan standar tinggi yang telah mereka tetapkan, memastikan bahwa setiap aplikasi yang sampai ke tangan pengguna telah melalui proses verifikasi yang ketat dan memenuhi ekspektasi kualitas Apple.

Terungkapnya Penggunaan Claude AI Internal oleh Apple

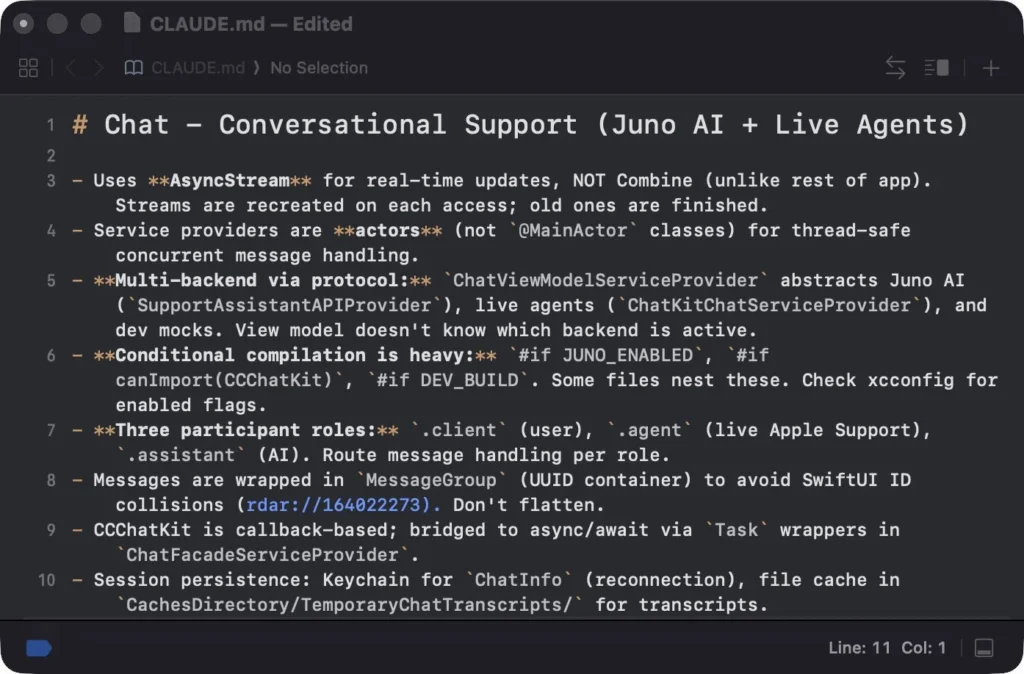

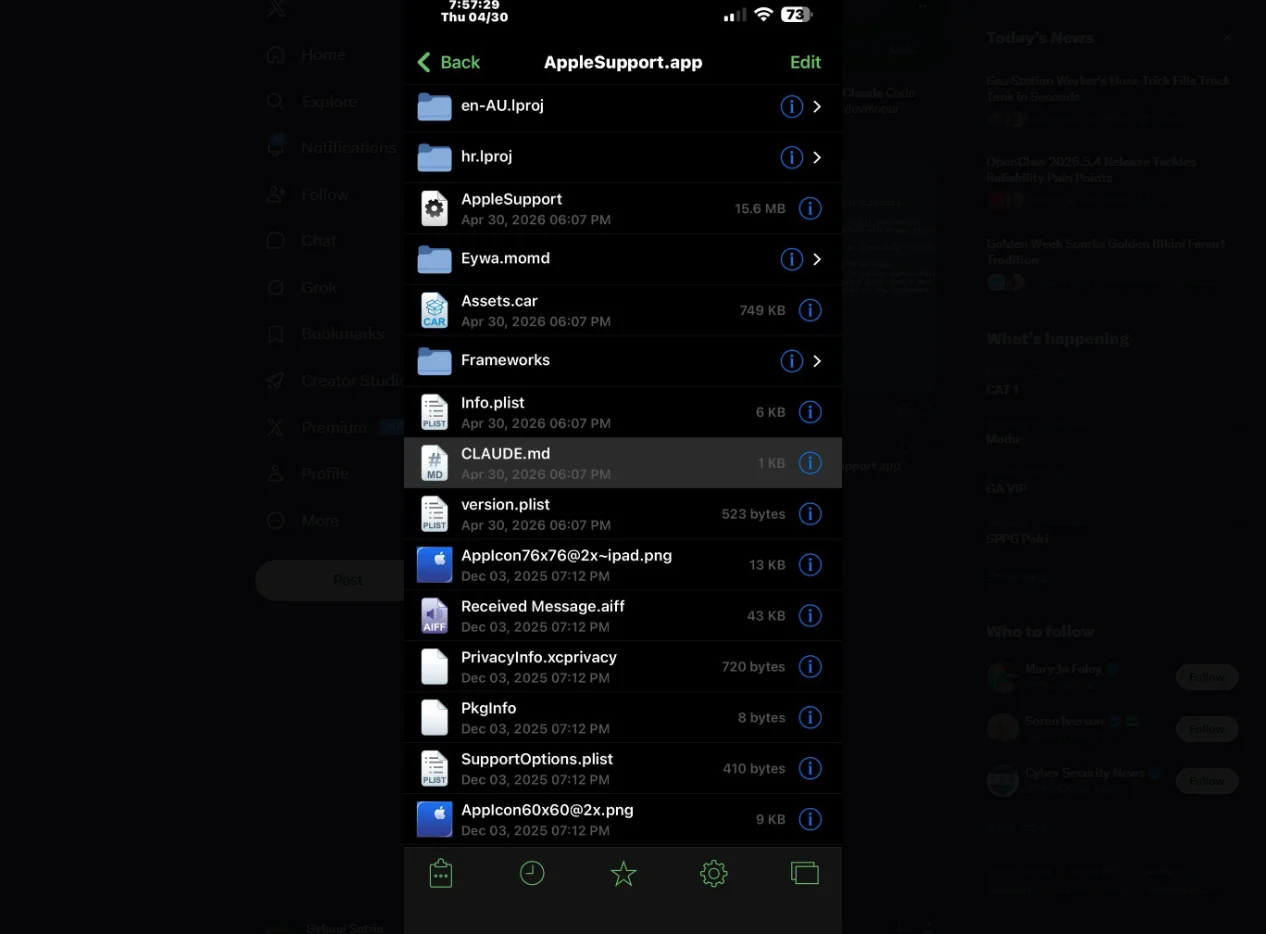

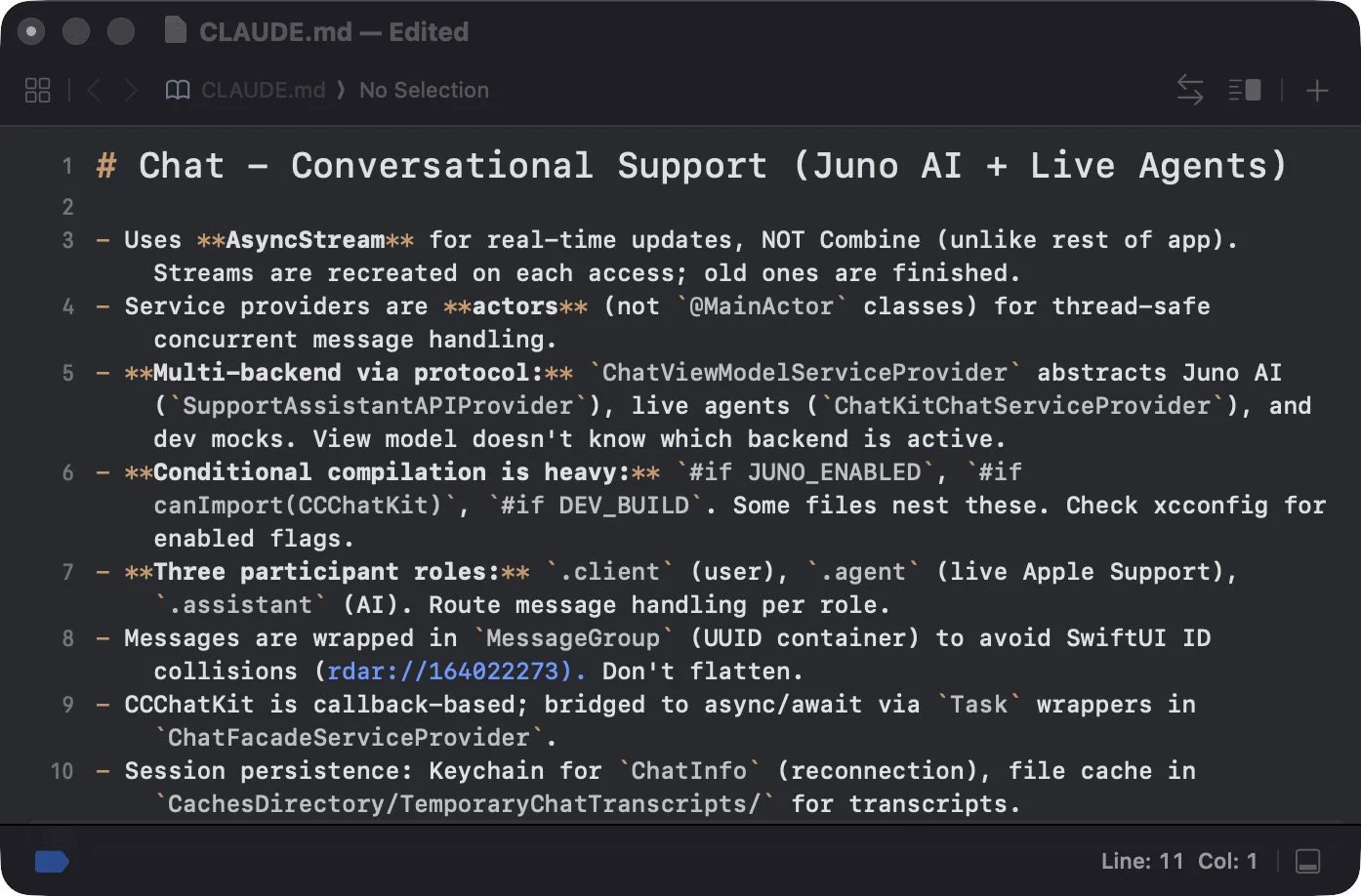

Kontroversi “Apple Blokir Aplikasi Vibe Coding” semakin memanas ketika laporan dari komunitas pengembang mengindikasikan adanya praktik yang bertolak belakang di internal perusahaan. Bukti kuat muncul setelah pembaruan aplikasi Apple Support ke versi 5.13. Dalam bundel aplikasi tersebut, ditemukan sebuah file bernama Claude.md. File ini, yang merupakan bagian dari konfigurasi internal, secara eksplisit mengungkap penggunaan Claude AI, sebuah model bahasa besar dari Anthropic, untuk mendukung fungsionalitas internal. Dokumen konfigurasi tersebut juga merinci penggunaan backend Juno AI dan tool SupportAssistantAPIProvider, menunjukkan bahwa Apple secara aktif mengintegrasikan teknologi AI generatif untuk alur kerja mereka. Penemuan ini segera memicu perdebatan luas di kalangan pengembang dan pengamat teknologi. Bagaimana mungkin Apple melarang aplikasi yang menggunakan pendekatan serupa di App Store, namun di saat yang sama, memanfaatkan teknologi tersebut untuk operasional internalnya? Ini mengingatkan kita pada diskusi mengenai integrasi AI di platform lain seperti fitur AI Chrome, dan menimbulkan pertanyaan serius tentang konsistensi serta transparansi kebijakan perusahaan.

Reaksi Apple: Penghapusan Diam-diam dan Perdebatan Standar Ganda

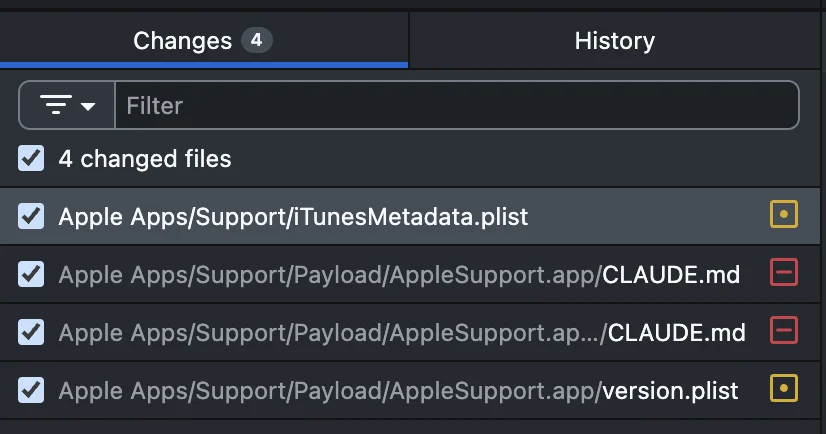

Menanggapi kehebohan yang muncul, Apple dengan cepat merilis pembaruan baru untuk aplikasi Apple Support, yaitu versi 5.13.1. Dalam pembaruan ini, file Claude.md yang menjadi sumber kontroversi telah dihapus dari bundel aplikasi. Menariknya, dalam catatan perubahan resmi di App Store, Apple tidak memberikan penjelasan spesifik mengenai penghapusan file tersebut. Mereka hanya mencantumkan perbaikan performa dan bug umum, seperti yang biasa terjadi pada pembaruan aplikasi rutin. Tindakan “penghapusan diam-diam” ini semakin memperkuat spekulasi publik mengenai adanya standar ganda dalam kebijakan Apple. Di satu sisi, mereka bersikeras menjaga kualitas dan keamanan App Store dengan menolak aplikasi “vibe coding”. Di sisi lain, penggunaan AI generatif secara internal, yang kemudian dihapus tanpa penjelasan, menunjukkan bahwa Apple sendiri mengakui potensi nilai dari teknologi tersebut. Perdebatan pun bergeser pada apakah ada perbedaan fundamental antara penggunaan internal yang terkontrol penuh dan aplikasi pihak ketiga yang dilepas ke publik.

Memahami Nuansa: Internal vs. Publik dan Masa Depan Inovasi AI

Meskipun kontroversi ini menyoroti dugaan standar ganda, penting untuk memahami nuansa di balik kebijakan Apple. Perusahaan berargumen bahwa ada perbedaan signifikan antara penggunaan teknologi AI secara internal dan aplikasi pihak ketiga yang dirilis ke publik melalui App Store. Untuk proyek internal, Apple memiliki kontrol penuh atas proses pengembangan, pengujian, dan validasi. Mereka dapat menerapkan protokol keamanan dan kualitas yang sangat ketat, serta melakukan penyesuaian cepat jika ada masalah. Sebaliknya, aplikasi “vibe coding” dari pihak ketiga yang beredar di App Store berpotensi menghasilkan kode secara dinamis di sisi pengguna, membuatnya sulit untuk dikontrol dan diverifikasi melalui proses review tradisional. Tantangan bagi Apple adalah bagaimana menyeimbangkan antara menjaga integritas dan keamanan ekosistem App Store yang telah dibangun dengan susah payah, sambil tetap merangkul inovasi yang dibawa oleh AI generatif. Dalam konteks pengembangan AI, banyak perusahaan juga mempertimbangkan outsourcing proyek AI untuk efisiensi. Masa depan mungkin akan melihat Apple mengembangkan pedoman yang lebih jelas dan alat verifikasi yang lebih canggih untuk aplikasi berbasis AI, memungkinkan pengembang untuk memanfaatkan teknologi ini tanpa mengorbankan standar kualitas dan keamanan yang menjadi ciri khas Apple.

Pertanyaan yang Sering Diajukan (FAQ)

“Vibe coding” merujuk pada pengembangan aplikasi yang sangat bergantung pada AI generatif untuk menghasilkan kode secara cepat. Apple melarangnya karena kekhawatiran akan kualitas, keamanan, dan konsistensi kode yang sulit diverifikasi melalui proses review tradisional, yang dapat merusak integritas ekosistem App Store.

Apple diduga menggunakan Claude AI untuk alur kerja internal, seperti yang terungkap dari file Claude.md di aplikasi Apple Support. Perusahaan mungkin berargumen bahwa penggunaan internal berbeda karena mereka memiliki kontrol penuh atas pengujian dan validasi, tidak seperti aplikasi pihak ketiga yang dilepas ke publik.

Kesimpulan

Kontroversi seputar “Apple Blokir Aplikasi Vibe Coding” namun diduga memanfaatkan Claude AI secara internal telah membuka diskusi penting mengenai konsistensi kebijakan perusahaan teknologi raksasa dan implikasi dari adopsi AI generatif. Meskipun Apple berupaya menjaga kualitas dan keamanan App Store dengan menolak aplikasi yang dianggap berisiko, penemuan penggunaan AI serupa di internal mereka memunculkan pertanyaan tentang standar ganda. Perdebatan ini menyoroti tantangan yang dihadapi Apple dalam menyeimbangkan antara inovasi dan kontrol. Ke depannya, Apple kemungkinan akan perlu merumuskan kerangka kerja yang lebih transparan dan adaptif untuk teknologi AI, baik untuk penggunaan internal maupun eksternal, demi menjaga kepercayaan pengembang dan pengguna. Hal ini krusial untuk memastikan bahwa ekosistem Apple tetap menjadi garda terdepan inovasi tanpa mengorbankan prinsip-prinsip inti mereka.