Di tengah pusaran konflik geopolitik yang memanas dan perdebatan sengit tentang etika penggunaan kecerdasan buatan (AI) dalam ranah militer, sebuah ironi mencuat ke permukaan. Militer Amerika Serikat (AS) dilaporkan secara aktif memanfaatkan teknologi AI Claude dari Anthropic untuk mendukung operasi intelijen gabungannya dengan Israel di wilayah Iran. Situasi ini menjadi sangat menarik mengingat beberapa hari sebelum laporan ini beredar, pemerintahan Donald Trump secara resmi mengeluarkan larangan penggunaan teknologi dari Anthropic di seluruh lini pemerintahan dan militer AS.

Kisah ini tidak hanya menyoroti ketegangan di Timur Tengah, tetapi juga membuka diskusi mendalam mengenai bagaimana teknologi canggih seperti AI berinteraksi dengan kebijakan pemerintah, celah regulasi, serta prinsip-prinsip etika yang dipegang oleh pengembangnya. Lebih jauh, insiden ini memperlihatkan dinamika persaingan antara raksasa AI seperti Anthropic dan OpenAI, serta dampaknya terhadap persepsi publik dan pasar. Artikel ini akan mengupas tuntas peran krusial AI Claude dalam operasi intelijen AS, menelusuri bagaimana celah regulasi dimanfaatkan, serta menganalisis pertarungan filosofi etika yang membentuk masa depan AI dalam konteks militer.

Peran Krusial AI Claude sebagai Otak Analisis Intelijen Militer AS

Berlawanan dengan kekhawatiran banyak pihak yang membayangkan AI sebagai senjata otonom, Komando Pusat AS (CENTCOM) memastikan bahwa AI Claude tidak pernah terhubung dengan sistem persenjataan mematikan. Dalam operasi di Iran, Claude tidak memiliki kemampuan untuk mengendalikan drone, meluncurkan rudal, atau menentukan target manusia secara langsung. Sebaliknya, AI ini diperankan sebagai 'otak' analitik utama, bertugas memproses jutaan data mentah yang datang dari medan perang dengan kecepatan dan akurasi yang tak tertandingi.

Tugas-tugas utama AI Claude meliputi pembedahan citra satelit resolusi tinggi, pemetaan jalur logistik paling efisien untuk pergerakan pasukan, hingga penerjemahan sadapan komunikasi radio berbahasa Persia (Farsi) secara instan. Dengan kapasitasnya yang luar biasa dalam mencerna dokumen teks dalam jumlah masif (dikenal sebagai 'context window' yang besar), Claude secara signifikan memangkas waktu yang dibutuhkan personel militer untuk mengambil keputusan taktis di lapangan. Kemampuan ini vital dalam lingkungan operasi yang serba cepat dan penuh tekanan, memungkinkan respons yang lebih cepat dan terinformasi.

Celah Regulasi: Mengapa Militer AS Tetap Menggunakan Claude?

Penggunaan AI Claude oleh militer AS memicu pertanyaan besar, mengingat Menteri Pertahanan AS, Pete Hegseth, sebelumnya telah melabeli Anthropic sebagai entitas dengan 'risiko keamanan nasional' yang berujung pada instruksi pemblokiran resmi dari pemerintahan Trump. Namun, Pentagon berhasil memanfaatkan sebuah celah regulasi krusial. Dokumen pelarangan tersebut memuat aturan masa transisi selama enam bulan, memberikan waktu bagi militer dan lembaga negara untuk secara bertahap memensiunkan sistem Anthropic, guna menghindari kelumpuhan operasional di tengah konflik yang sedang berlangsung.

Mengutip laporan investigasi dari Wall Street Journal, militer AS secara sengaja memaksimalkan masa tenggang enam bulan ini. Pentagon sangat bergantung pada Claude dan kesulitan menemukan AI pengganti dari vendor lain yang memiliki tingkat halusinasi (kesalahan data) serendah buatan Anthropic, terutama untuk analisis intelijen tingkat militer yang membutuhkan akurasi tinggi. Ketergantungan ini menggarisbawahi tantangan dalam mengganti sistem AI yang telah terintegrasi dalam operasi sensitif, terutama ketika risiko seperti kelumpuhan internet Iran akibat serangan siber juga menjadi perhatian. Ini menunjukkan kompleksitas antara kebutuhan operasional dan kepatuhan regulasi.

Dilema Etika: Sikap Anthropic Berbanding Terbalik dengan OpenAI

Akar dari pelarangan ini bermula dari perselisihan mendalam antara pemerintah AS dan Anthropic. Kemarahan pemerintahan Trump dipicu oleh sikap tegas CEO Anthropic, Dario Amodei, yang secara konsisten menolak memberikan akses tingkat lanjut sistem AI perusahaannya kepada Pentagon. Penolakan ini terutama berlaku jika teknologi tersebut berpotensi digunakan untuk pengembangan senjata otonom atau pengawasan massal. Anthropic berpegang teguh pada prinsip AI yang etis dan aman, melarang keras produknya dipakai untuk fasilitas militer ofensif, sebuah pendirian yang memicu sanksi pemblokiran.

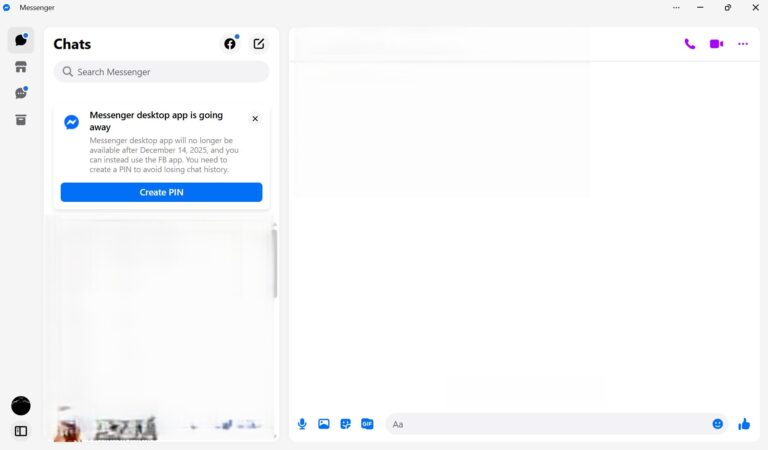

Di sisi lain, rival utama Anthropic, OpenAI, mengambil langkah yang berlawanan. CEO Sam Altman melihat peluang dari keretakan hubungan Anthropic dengan pemerintah AS. OpenAI dilaporkan telah sepakat untuk mengizinkan Departemen Pertahanan AS memasang teknologi di balik ChatGPT ke dalam jaringan militer rahasia mereka. Langkah ini sontak memicu reaksi keras dari masyarakat sipil dan komunitas teknologi global. Keputusan OpenAI ini dinilai mengkhianati janji awal mereka yang mengklaim tidak akan menggunakan AI untuk keperluan perang, memicu kampanye global 'Cancel ChatGPT' sebagai bentuk boikot.

Dampak Pasar dan Pergeseran Persepsi Publik terhadap Etika AI

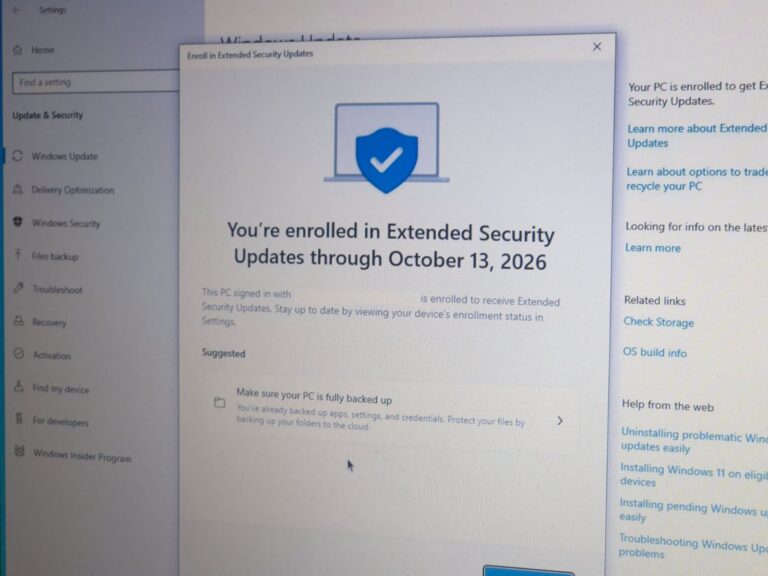

Drama geopolitik dan etika teknologi ini langsung terasa di pasar aplikasi konsumen. Keteguhan Anthropic yang menolak tunduk pada militer untuk urusan senjata justru menuai simpati luar biasa dari publik luas. Banyak pengguna internet melakukan 'eksodus digital', ramai-ramai membatalkan langganan berbayar ChatGPT dan beralih mengunduh aplikasi Claude. Dampaknya sangat signifikan; hanya dalam waktu singkat, aplikasi Claude meroket pesat dan berhasil merebut posisi nomor satu sebagai aplikasi gratis paling banyak diunduh di Apple App Store.

Kasus ini membuktikan bahwa konsumen kini semakin peduli terhadap etika penggunaan AI dan dampak sosialnya. Bagi militer AS, mereka kini berpacu dengan waktu untuk mencari AI pengganti yang setara dalam sisa masa transisi enam bulan. Jika gagal, mereka mungkin terpaksa kembali ke metode analisis manual yang berisiko memperlambat manuver dan pengambilan keputusan taktis di wilayah yang krusial seperti Timur Tengah. Ini menjadi bukti nyata bahwa kepercayaan publik dan prinsip etika dapat memengaruhi dinamika pasar dan bahkan strategi keamanan nasional.

Pertanyaan yang Sering Diajukan (FAQ)

AI Claude berfungsi sebagai analis intelijen canggih, memproses data mentah seperti citra satelit, memetakan jalur logistik, dan menerjemahkan komunikasi berbahasa Farsi. AI ini tidak digunakan sebagai senjata otonom, melainkan untuk mempercepat pengambilan keputusan taktis oleh personel militer AS dalam operasi di Iran.

Militer AS tetap menggunakan Claude karena memanfaatkan celah regulasi berupa masa transisi enam bulan setelah larangan resmi dari pemerintahan Trump. Pentagon sangat bergantung pada Claude karena tingkat halusinasi (kesalahan data) yang rendah, dan kesulitan menemukan alternatif AI lain yang setara dalam waktu singkat untuk analisis intelijen tingkat militer yang krusial.

Kesimpulan

Fenomena penggunaan AI Claude oleh intelijen AS di tengah larangan pemerintahan Trump menggambarkan kompleksitas hubungan antara teknologi canggih, kebijakan, dan etika. Meskipun dilarang, peran Claude sebagai otak analisis data menunjukkan urgensi kebutuhan militer akan AI yang akurat dan efisien. Di sisi lain, perbedaan sikap antara Anthropic dan OpenAI dalam militerisasi AI menyoroti dilema etis yang mendalam, sekaligus memicu reaksi kuat dari publik yang kini semakin sadar akan dampak AI.

Lonjakan popularitas Claude di pasar aplikasi adalah cerminan dari pergeseran nilai konsumen yang mengutamakan etika. Kasus ini bukan hanya tentang inovasi teknologi, tetapi juga tentang bagaimana nilai-nilai kemanusiaan dan kebijakan akan membentuk arah pengembangan AI di masa depan. Kita semua memiliki peran untuk memahami dan menyuarakan pandangan kita tentang bagaimana teknologi ini harus digunakan. Dapatkan wawasan mendalam tentang teknologi dan etika AI yang membentuk masa depan kita.